Khi AI càng thông minh thì sự “ghi nhớ ngữ cảnh” lại càng trở nên quan trọng. Nhưng bạn có biết, LLM hiện nay vẫn thường quên mình đang nói chuyện với ai, vì sao, và để làm gì?

💡 MCP là gì?

Model Context Protocol (MCP) là một giao thức mở được phát triển bởi Anthropic (Claude AI), nhằm giải quyết vấn đề chia sẻ ngữ cảnh giữa LLM và các nguồn dữ liệu bên ngoài.

Hãy tưởng tượng:

- Bạn có LLM A (Claude, GPT, Gemini…)

- Bạn có dữ liệu ở 5 nơi: Google Drive, Slack, Notion, CRM, API nội bộ

- Bạn muốn LLM dùng đúng dữ liệu, đúng ngữ cảnh, không cần prompt hack

➡️ MCP là “chuẩn USB-C” giúp kết nối đó trở nên mượt mà.

🧱 Kiến trúc MCP – đơn giản nhưng cực kỳ tinh tế

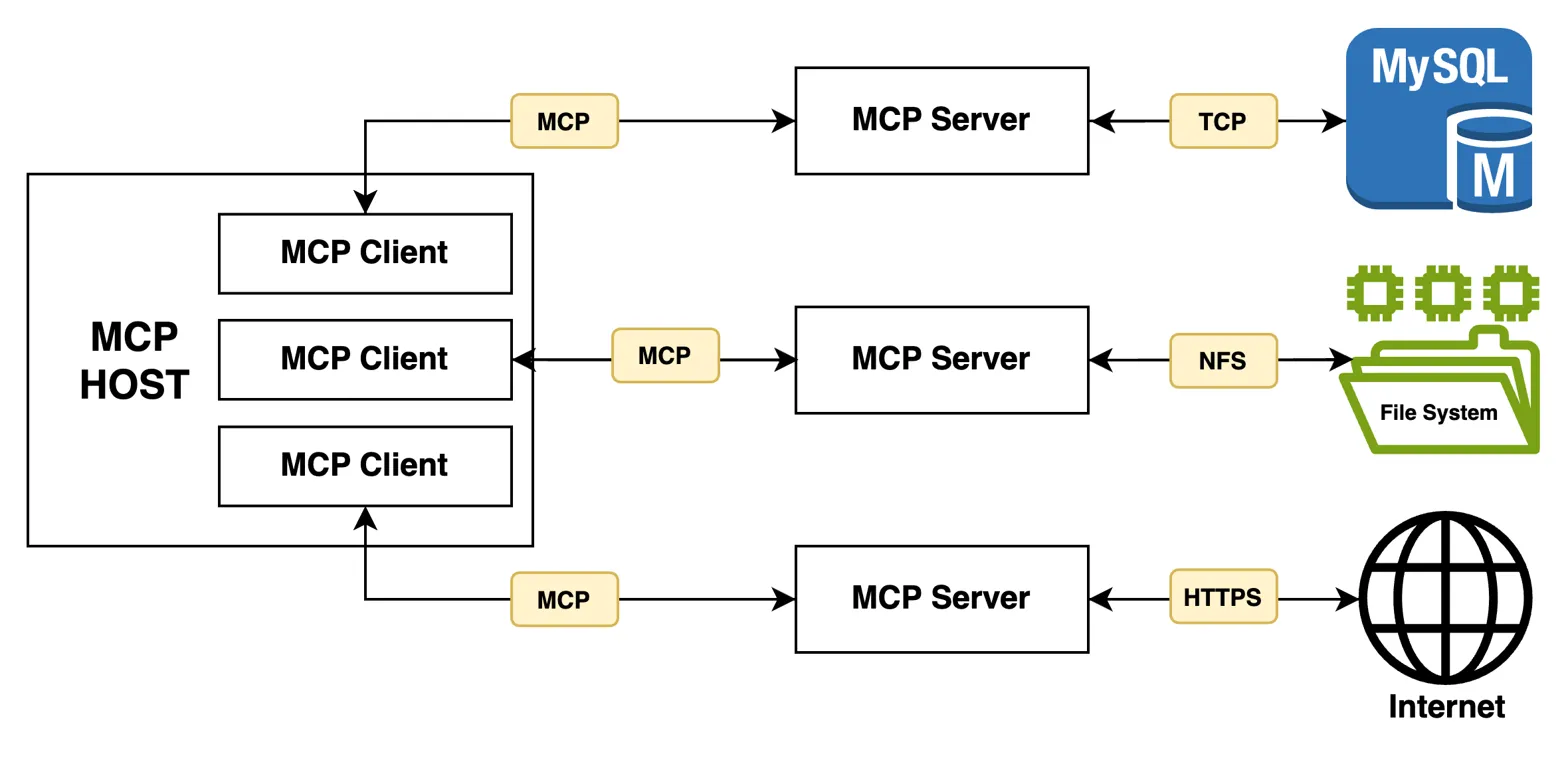

MCP định nghĩa 3 thành phần chính:

- Host: Ứng dụng chính, giữ toàn bộ ngữ cảnh và điều phối logic

- Client: Trung gian giữa Host và các nguồn dữ liệu hoặc công cụ

- Server: Mỗi server cung cấp dữ liệu hoặc chức năng cụ thể (ví dụ: đọc file, gọi API, truy vấn DB…)

➡️ Mỗi LLM không “thấy hết mọi thứ” mà chỉ nhận được đúng phần context cần thiết, đúng lúc. ➡️ Cơ chế JSON-RPC + Session-based + LLM-agnostic giúp mọi thứ diễn ra bảo mật, linh hoạt và có thể debug rõ ràng.

🤖 Ứng dụng mạnh mẽ trong hệ thống đa tác tử (Multi-Agent)

MCP cực kỳ lý tưởng cho các hệ thống AI hiện đại kiểu:

- Một agent điều phối nhiều sub-agent

- Mỗi sub-agent đảm nhiệm 1 tác vụ chuyên biệt: tìm kiếm, phân tích, báo cáo

- Mỗi agent có context riêng nhưng được hợp nhất dưới 1 Host điều phối

Ví dụ: Claude AI có thể tạo 4 agent song song để thu thập thông tin từ các nguồn khác nhau, rồi tổng hợp lại thành một báo cáo duy nhất. Tất cả điều này được thực hiện qua MCP-based coordination.

⚙️ Tích hợp LLM thông minh hơn – Không chỉ RAG

MCP không thay thế RAG, mà… bổ sung sức mạnh cho RAG.

- Giúp chọn đúng công cụ, đúng dữ liệu (RAG-MCP hybrid)

- Giảm “prompt overload” khi nhiều công cụ được đưa vào mô hình

- Dễ chuyển đổi giữa các LLM (Claude → GPT → Gemini…) mà không cần viết lại connector

Bạn có thể dùng MCP để:

- Tạo hệ thống AI giúp nhân viên tìm file, trích xuất số liệu, ra quyết định

- Tích hợp vào IDE để AI hiểu project context, gọi đúng công cụ dev

- Xây trợ lý cá nhân có thể suy luận liên tục qua nhiều session

✅ Lợi ích với doanh nghiệp và đội ngũ kỹ thuật

Với Technical Leads / Devs:

- Tách biệt logic & data layer

- Test dễ, trace dễ, cấu hình linh hoạt

- Xây hệ thống agent có khả năng reasoning qua nhiều bước

Với Product / PM:

- Tiết kiệm thời gian tích hợp (1 chuẩn – nhiều nền tảng)

- Dễ mở rộng qua các công cụ/dữ liệu nội bộ

- Tăng độ tin cậy và “trí nhớ dài hạn” của AI

⚠️ Nhưng cũng có thách thức

- Cần kiến trúc ban đầu rõ ràng, biết phân loại ngữ cảnh

- Triển khai server nội bộ đòi hỏi hạ tầng và quản lý bảo mật tốt

- Prompt bloat nếu lạm dụng nhiều công cụ cùng lúc mà không RAG tốt

✨ Kết luận

MCP không làm cho AI thông minh hơn. Nhưng nó giúp AI hoạt động có trật tự và có… trí nhớ hơn.

Với tương lai multi-agent, multi-LLM đang rất gần, một giao thức như MCP chính là cầu nối để xây dựng những hệ thống AI:

- Tư duy dài hạn

- Giao tiếp liền mạch

- Kết nối chuẩn hóa, dễ debug, dễ bảo trì

📣 Bạn đã thử dùng MCP hoặc một framework context nào tương tự chưa? Có muốn mình chia sẻ tiếp về MCP + RAG + Function Calling + LangGraph?

📎 Nguồn tham khảo: Anthropic Docs, Claude Research Team, open-spec MCP GitHub.